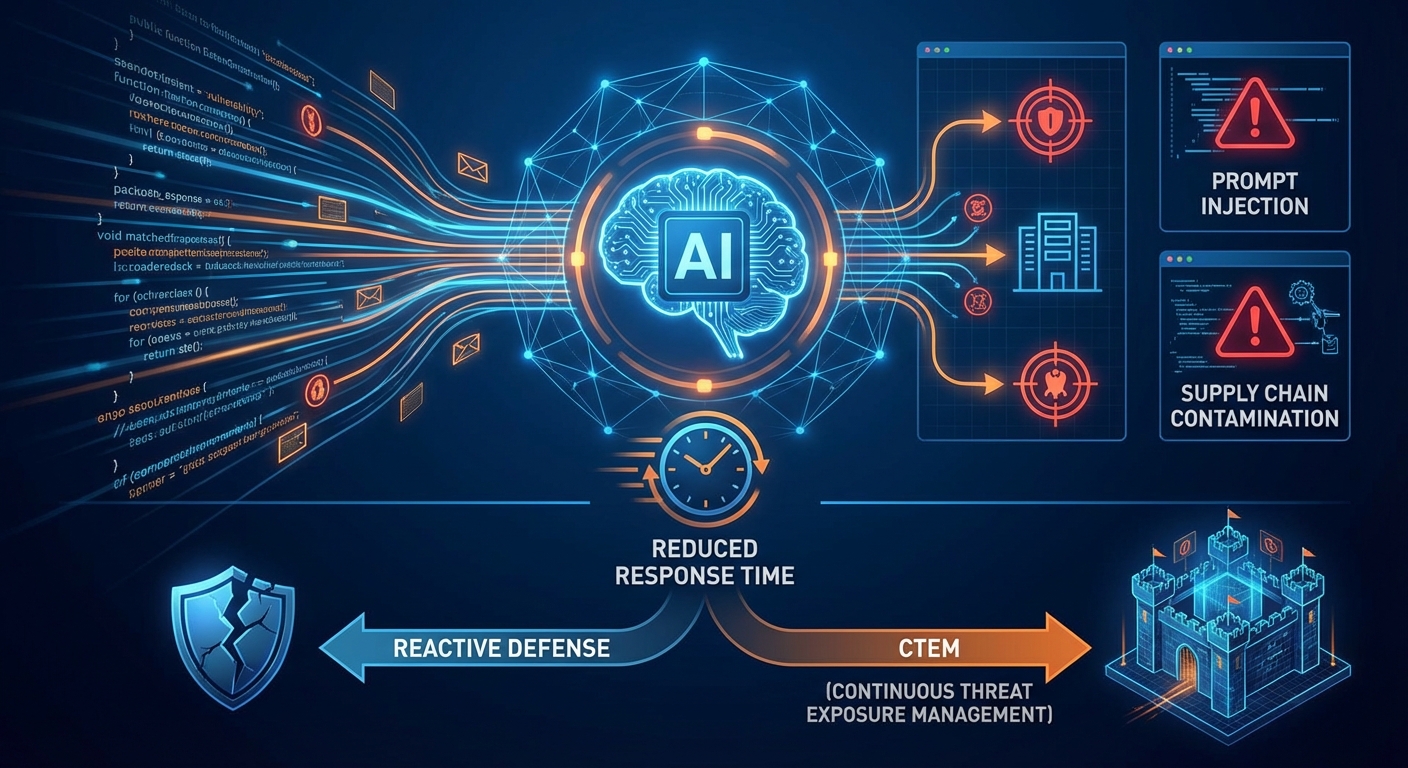

บทความนี้เน้นย้ำถึงบทบาทของ AI ในการเร่งความเร็วของการโจมตีทางไซเบอร์ โดย AI สามารถค้นหาช่องโหว่และช่องทางการโจมตีในระบบได้ภายในไม่กี่นาที ซึ่งทำให้กรอบเวลาตอบสนองของทีมรักษาความปลอดภัยลดลงอย่างมาก นอกจากนี้ AI ยังสร้างพื้นผิวการโจมตีใหม่ๆ โดยการโจมตีโครงสร้างพื้นฐาน AI เอง เช่น การฉีดพรอมต์ (prompt injection) และการปนเปื้อนซัพพลายเชน องค์กรต่างๆ จำเป็นต้องเปลี่ยนแนวทางการป้องกันจากการแก้ไขแบบตั้งรับไปสู่การจัดการความเสี่ยงจากการเปิดเผยภัยคุกคามอย่างต่อเนื่อง (CTEM) เพื่อรับมือกับภัยคุกคามที่ขับเคลื่อนด้วย AI

Severity: วิกฤต

System Impact:

- Cloud workloads

- Identity relationships

- Critical assets

- API keys

- S3 buckets (misconfigured)

- Production databases

- Machine identities

- Dev containers (low-security)

- Automated backup scripts

- Public-facing AI support agents

- Internal databases

- EDR tools

- Large Language Models (LLMs)

- AI coding assistants

- CI/CD pipelines

Technical Attack Steps:

- AI ค้นหา Cloud Workloads ที่มีสิทธิ์เข้าถึงมากเกินไป (over-permissioned workload)

- AI ทำการแมปความสัมพันธ์ของข้อมูลประจำตัว (identity relationships) และคำนวณเส้นทางที่เป็นไปได้ไปยังสินทรัพย์ที่สำคัญ

- AI จำลองการโจมตีหลายพันครั้งและเริ่มดำเนินการภายในไม่กี่นาที

- มีการใช้ช่องโหว่ CVEs มากกว่า 32% ในวันเดียวกับหรือก่อนวันที่ CVE ถูกเปิดเผย

- AI เชื่อมโยงช่องโหว่ระดับ ‘ต่ำ’ และ ‘ปานกลาง’ เข้าด้วยกัน เช่น ข้อมูลรับรองที่หมดอายุ หรือ S3 bucket ที่กำหนดค่าผิดพลาด

- AI ใช้เทคนิค ‘identity hopping’ เพื่อแมปเส้นทางการแลกเปลี่ยนโทเค็นจาก dev container ที่มีความปลอดภัยต่ำไปยังฐานข้อมูลการผลิตที่มีมูลค่าสูง

- AI สร้างข้อความฟิชชิ่งที่ ‘เข้าใจบริบท’ ได้อย่างสมบูรณ์แบบ ทำให้การโจมตีฟิชชิ่งเพิ่มขึ้นถึง 1,265%

- ผู้โจมตีใช้เทคนิค ‘prompt injection’ เพื่อหลอก AI agent ที่ติดต่อกับสาธารณะให้เรียกดูฐานข้อมูลภายในที่เข้าถึงไม่ได้

- ผู้โจมตีป้อนข้อมูลเท็จเข้าสู่หน่วยความจำระยะยาวของ AI (Vector Store) เพื่อสร้าง ‘dormant payload’ ที่จะทำให้ AI ทำหน้าที่เป็นภัยคุกคามภายใน

- ผู้โจมตีใช้ LLMs เพื่อคาดเดาชื่อแพ็กเกจ ‘hallucinated’ ที่ AI coding assistants อาจแนะนำ จากนั้นลงทะเบียนแพ็กเกจที่เป็นอันตราย (slopsquatting) เพื่อฝัง backdoor เข้าสู่ CI/CD pipeline โดยตรง

Recommendations:

Short Term:

- จัดลำดับความสำคัญในการแก้ไขความเสี่ยงที่ก่อให้เกิดเส้นทางการโจมตีที่เข้าถึงสินทรัพย์สำคัญ โดยเน้นที่ ‘จุดบรรจบ’ ที่มีความเสี่ยงหลายอย่างมาเกี่ยวข้องกัน

- ตรวจสอบสิทธิ์การเข้าถึงที่กว้างขวางเกินไป (overly broad permissions) และ API key ที่ไม่ได้ถูกยกเลิก โดยเฉพาะอย่างยิ่งในสภาพแวดล้อมคลาวด์และการพัฒนา

- เสริมสร้างการตรวจจับฟิชชิ่งและการรับรู้ของพนักงานต่อการโจมตีทางสังคมที่สร้างโดย AI

- ตรวจสอบและรักษาความปลอดภัยของ Machine Identities ทั้งหมด (keys, tokens, service accounts) เพื่อป้องกันการโจมตีแบบ Identity Hopping

Long Term:

- เปลี่ยนแนวทางจากการแก้ไขช่องโหว่แบบตั้งรับ (reactive patching) ไปสู่การจัดการความเสี่ยงจากการเปิดเผยภัยคุกคามอย่างต่อเนื่อง (Continuous Threat Exposure Management – CTEM) เพื่อให้สอดคล้องกับความเสี่ยงทางธุรกิจที่แท้จริง

- นำเครื่องมือรักษาความปลอดภัยที่ขับเคลื่อนด้วย AI มาใช้เพื่อวิเคราะห์กราฟข้อมูลประจำตัวและ Telemetry ได้อย่างรวดเร็ว เพื่อระบุและจัดลำดับความสำคัญของเส้นทางการโจมตีที่สามารถใช้ประโยชน์ได้

- พัฒนากลไกการรักษาความปลอดภัยที่แข็งแกร่งสำหรับโครงสร้างพื้นฐาน AI รวมถึงโปรโตคอลการจัดการบริบทของโมเดลที่เข้มงวดและจำกัดการเข้าถึง เพื่อป้องกันการโจมตีแบบ Prompt Injection

- ใช้กลไกในการตรวจสอบความสมบูรณ์ของข้อมูลในหน่วยความจำของ AI agent (Vector Stores) เพื่อป้องกันการโจมตีแบบ ‘Poisoning the Well’

- เสริมสร้างกระบวนการรักษาความปลอดภัยของ Supply Chain เพื่อป้องกัน ‘Supply Chain Hallucinations’ และ Slopsquatting โดยอาจใช้ Trusted Registries และ Code Scanning

Source: https://thehackernews.com/2026/02/from-exposure-to-exploitation-how-ai.html

Share this content: