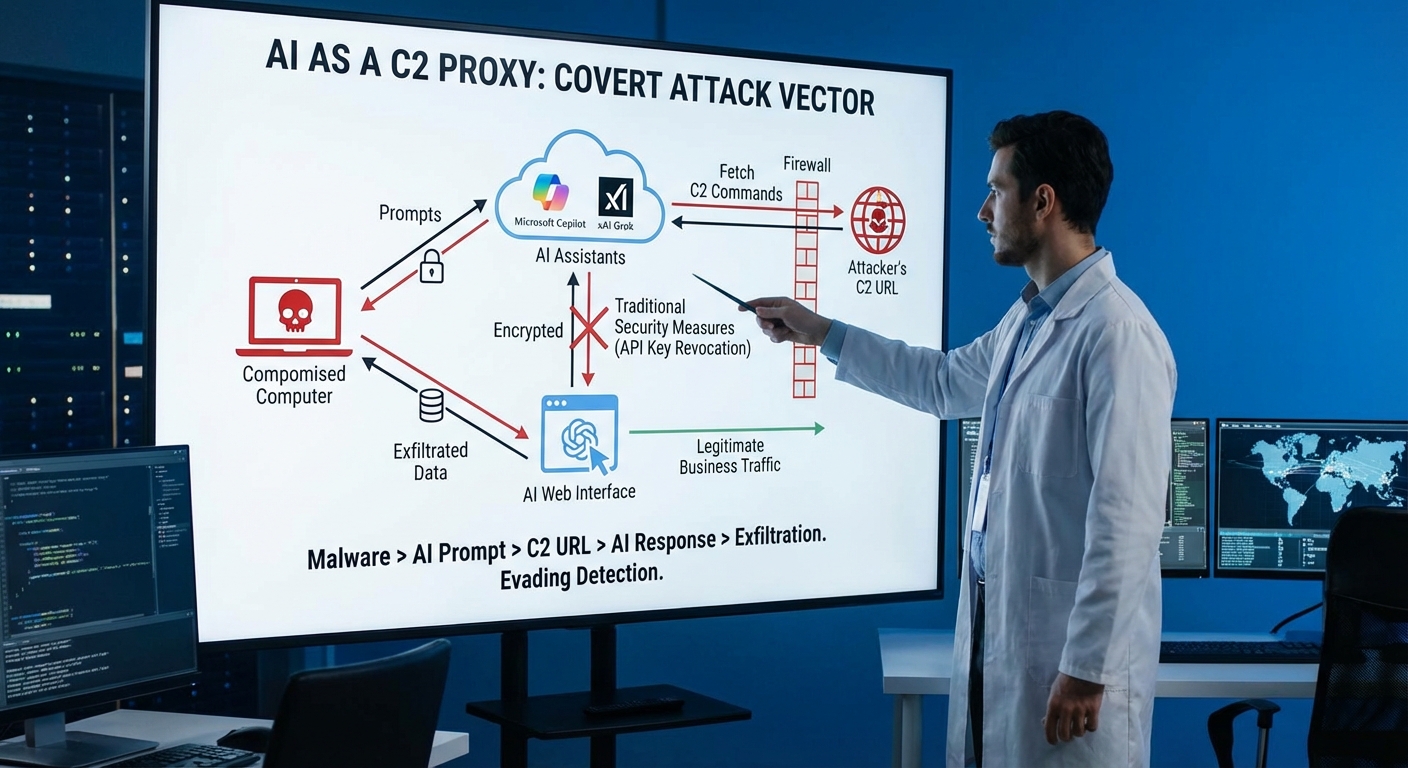

นักวิจัยด้านความมั่นคงปลอดภัยทางไซเบอร์เปิดเผยว่า ผู้ช่วย AI อย่าง Microsoft Copilot และ xAI Grok ที่มีความสามารถในการเข้าถึงเว็บหรือดึงข้อมูล URL สามารถถูกนำไปใช้เป็นช่องทาง Command-and-Control (C2) แบบซ่อนเร้นสำหรับมัลแวร์ได้ เทคนิคนี้เรียกว่า “AI as a C2 proxy” ซึ่งช่วยให้ผู้โจมตีสามารถผสมผสานการสื่อสารที่เป็นอันตรายเข้ากับการสื่อสารทางธุรกิจที่ถูกต้องตามกฎหมาย เพื่อหลีกเลี่ยงการตรวจจับ การโจมตีนี้ต้องมีการบุกรุกระบบและติดตั้งมัลแวร์ในเบื้องต้น จากนั้นมัลแวร์จะใช้คำสั่ง (prompts) ที่ออกแบบมาเป็นพิเศษ เพื่อสั่งให้ AI ดึงคำสั่งจาก URL ที่ผู้โจมตีควบคุม และส่งข้อมูลกลับผ่านอินเทอร์เฟซเว็บของ AI ซึ่งเป็นการบ่งชี้ถึงวิวัฒนาการใหม่ในการใช้ AI ในทางที่ผิด ที่ขยายจากการสร้างโค้ดไปสู่การโจมตีอัตโนมัติแบบเรียลไทม์และการหลบเลี่ยงการตรวจจับ โดยข้ามมาตรการรักษาความปลอดภัยแบบดั้งเดิม เช่น การเพิกถอนคีย์ API

Severity: วิกฤต

System Impact:

- Microsoft Copilot

- xAI Grok

- ระบบผู้ช่วย AI ที่รองรับการเรียกดูเว็บหรือดึง URL

- การสื่อสารภายในองค์กร

- เครื่องโฮสต์ที่ถูกบุกรุก

Technical Attack Steps:

- ผู้โจมตีทำการบุกรุกเครื่องเป้าหมายและติดตั้งมัลแวร์

- มัลแวร์ที่ติดตั้งจะส่งคำสั่ง (prompts) ที่สร้างขึ้นมาเป็นพิเศษไปยังผู้ช่วย AI (เช่น Microsoft Copilot, xAI Grok) ที่มีความสามารถในการเข้าถึงเว็บหรือดึง URL

- ผู้ช่วย AI ดำเนินการตามคำสั่งโดยการดึงข้อมูลจาก URL ที่ผู้โจมตีควบคุม ซึ่งมีคำสั่งที่เป็นอันตรายซ่อนอยู่

- ผู้ช่วย AI ส่งข้อมูลตอบกลับ (ซึ่งมีคำสั่ง) ผ่านอินเทอร์เฟซเว็บที่ถูกต้องตามกฎหมายของตน

- มัลแวร์ดึงคำสั่งจากข้อมูลตอบกลับของ AI และดำเนินการบนเครื่องโฮสต์ที่ถูกบุกรุก หรือส่งข้อมูลเหยื่อออกไปผ่านช่องทางเดียวกัน

- ผู้โจมตีอาจใช้ผู้ช่วย AI เพื่อสร้างกลยุทธ์การหลบเลี่ยง, ดำเนินการสอดแนม, สคริปต์การกระทำต่างๆ และตัดสินใจในการปฏิบัติการแบบเรียลไทม์

Recommendations:

Short Term:

- ใช้ระบบ Endpoint Detection and Response (EDR) ที่แข็งแกร่งเพื่อตรวจจับและป้องกันการบุกรุกของมัลแวร์และการทำงานบนอุปกรณ์ปลายทาง

- เฝ้าระวังการจราจรเครือข่ายสำหรับรูปแบบการสื่อสารที่ผิดปกติหรือน่าสงสัยที่ส่งออกจากโฮสต์ภายในองค์กรไปยังโดเมนบริการ AI ที่ถูกต้องตามกฎหมาย (เช่น Copilot, Grok) โดยเฉพาะสำหรับการขโมยข้อมูลหรือการดึงคำสั่งที่ไม่คาดคิด

- ทบทวนและบังคับใช้นโยบายการแบ่งส่วนเครือข่ายอย่างเข้มงวด เพื่อจำกัดการเคลื่อนที่ด้านข้างของมัลแวร์หากโฮสต์ถูกบุกรุก

Long Term:

- ปรับปรุงข้อมูลภัยคุกคาม (Threat Intelligence) เพื่อทำความเข้าใจรูปแบบการโจมตีที่ขับเคลื่อนด้วย AI ใหม่ๆ และรวมเข้ากับการป้องกันความปลอดภัย

- พัฒนาระบบวิเคราะห์พฤติกรรมขั้นสูง เพื่อระบุปฏิสัมพันธ์ที่ผิดปกติกับบริการ AI ที่อาจบ่งชี้ถึงกิจกรรม C2

- ทำงานร่วมกับผู้ให้บริการ AI เพื่อเสริมสร้างมาตรการป้องกันความปลอดภัยของ AI และตรวจจับ/ลดการใช้ Prompt Engineering ในทางที่ผิด ที่อำนวยความสะดวกในการโจมตีแบบ C2

- นำสถาปัตยกรรม Zero Trust มาใช้อย่างครอบคลุม เพื่อยืนยันคำขอการเข้าถึงทุกครั้ง และลดผลกระทบจากการถูกบุกรุกข้อมูลประจำตัวหรือโฮสต์

- ให้ความรู้แก่ทีมรักษาความปลอดภัยเกี่ยวกับภูมิทัศน์ภัยคุกคามที่เปลี่ยนแปลงไปของการโจมตีที่ขับเคลื่อนด้วย AI และเทคนิคการตรวจจับ

Source: https://thehackernews.com/2026/02/researchers-show-copilot-and-grok-can.html

Share this content: